HuggingFace Pipeline

HuggingFace 中的pipeline

pipline是使用模型进行推理的一种很好且简单的方法。使用pipline()可以使用**Hub**中的任何模型来推理任何语言、计算机视觉、语音和多模式任务。而不用考虑模型底层代码。

这些pipline是从库中抽象出大部分复杂代码的对象,提供专用于多个任务的简单 API

简单使用

每个任务都有其关联的pipline,使用应用于特定任务的pipeline的时候,能够自动加载默认模型和能够处理该任务的预处理类

首先创建**pipeline()**并指定推理任务:

123from transformers import pipelinegenerator = pipeline(task="automatic-speech-recognition")

将输入文本传递给**pipeline()**:

1generator("https://huggingface.co/datasets/Narsil/asr_dummy/resolve/main/mlk.flac")

3.也可以更换参数量更大的模型进行推 ...

Transformers Quick Start

HuggingFace入门教程

快速入门

在开始之前, 确保你已经安装了所有必要的库:

1!pip install transformers datasets

你还需要安装喜欢的机器学习框架: pytorch

使用pipeline()是利用预训练模型进行推理的最简单的方式. 你能够将pipeline()开箱即用地用于跨不同模态的多种任务. 它支持的任务列表:

使用官方模型库中的模型

使用BLIP2作为例子,这是一个image-captioning的Image2Language模型

1from transformers import Blip2Processor, Blip2ForConditionalGeneration

使用GPU加速模型,通过processor将图片转化为模型输入,通过model实现输

123processor = Blip2Processor.from_pretrained("Salesforce/blip2-opt-2.7b")model = Blip2ForConditionalGeneration.from_pretrained(&qu ...

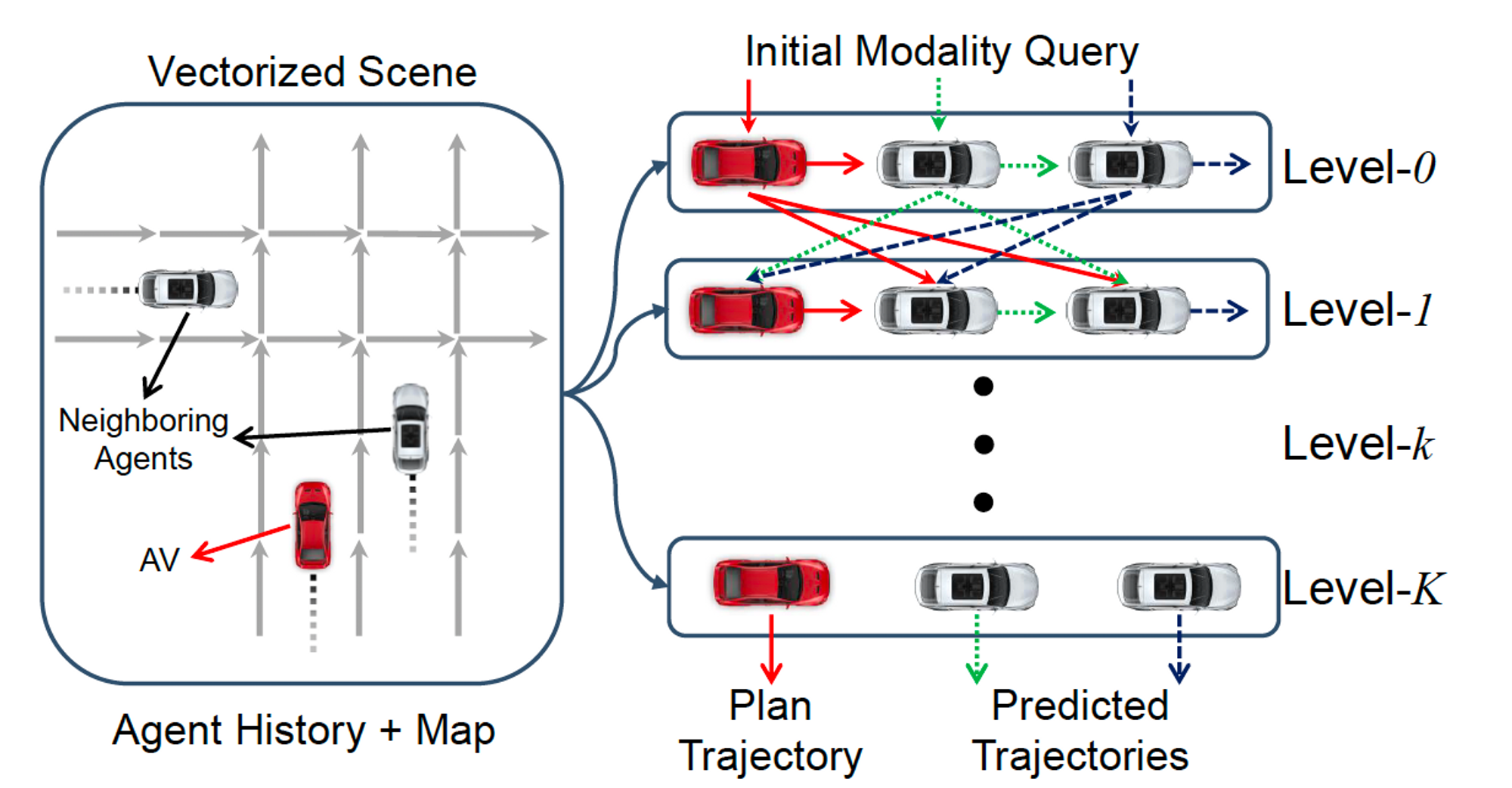

GameFormer

Author: Zhiyu Huang, Haochen Liu, Chen Lv

Code: https://mczhi.github.io/GameFormer/

Comment: level-k game theory for planning

Key Words: Fusion, Object Detection

Score: ⭐️⭐️⭐️⭐️⭐️

Source: ICCV2023

“hierarchical game theory” 的中文翻译是 “分层博弈论”。

trajectories翻译成中文是“轨迹”。

motion prediction 运动预测

level-k 理论是一个在行为经济学和游戏理论中使用的人类行为模型。它假设参与战略游戏的玩家根据其他玩家的行动预测来决定自己的举动。玩家因此可以按照理解其他玩家举动的深度来分类。级别-k理论假设每个玩家都认为自己是游戏中最精明的人。这被归因于许多因素,如“维护成本”或单纯的过分自信。玩家因此根据玩家认为其他竞争者所处的复杂程度而被归类为k级别。你认为他人愈幼稚,你的分类就愈低。这种模式延续至更高级别的玩家,但每个玩家只有 ...

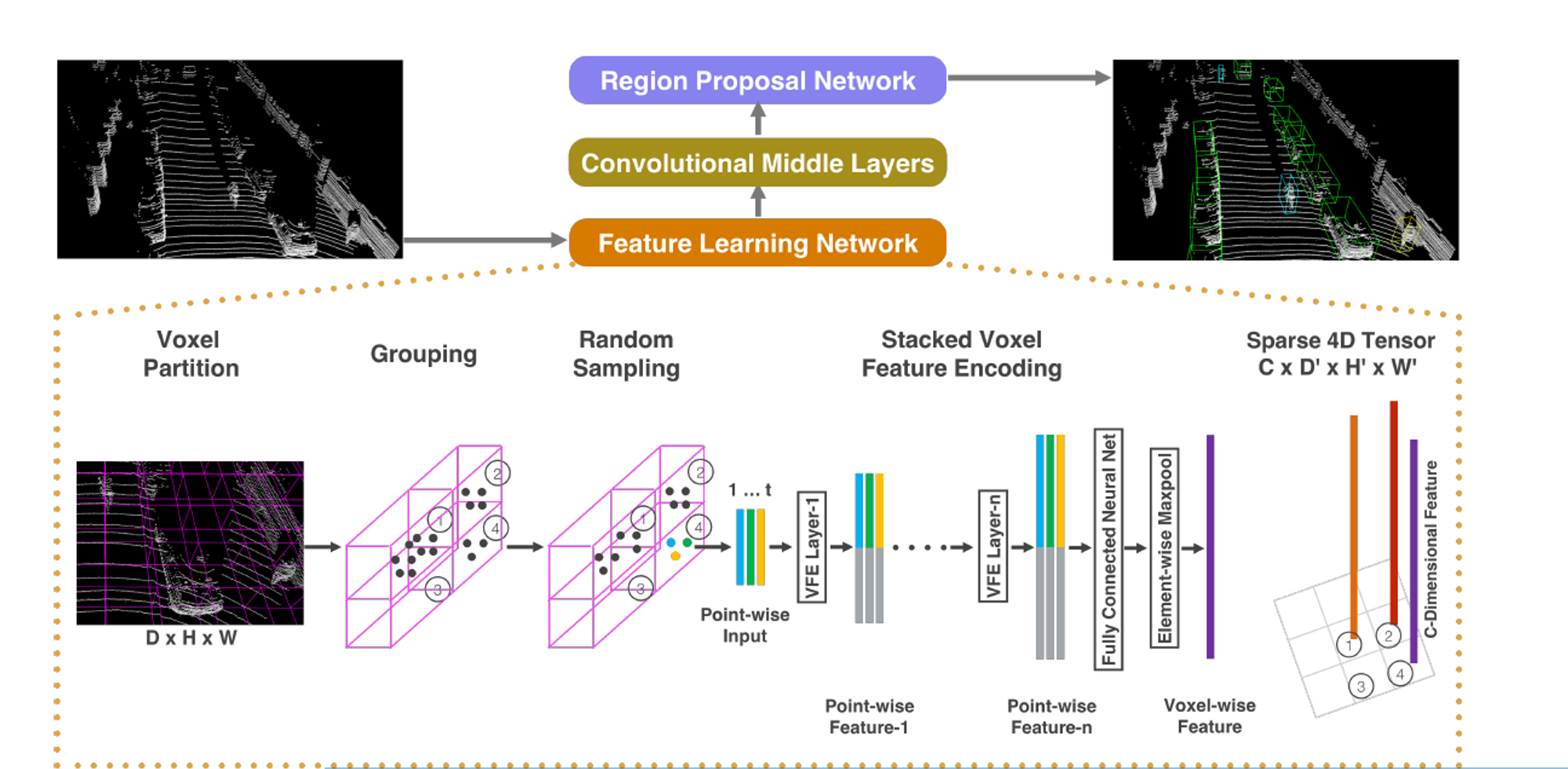

VoxelNet

Abstract

本文消除了对3D点云的手动特征工程的需要,提出了VoxelNet,将特征提取和bounding box统一到单个阶段、端到端的可训练深度网络中。

VoxelNet将点云划分为等距的3D体素,通过引入提速特征编码(VFE)层将每个体素内的一组点转化为统一的特征表示。

Introduction

针对现在对于3D点云还需要手动特征工程的需求,我们提出了VoxelNet:这是一个通用的3D检测框架,它以端到端的方式同时从点云中学习有区别的特征表示,并预测精确的3D边界框

主要贡献:

我们提出了一种新的端到端可训练的深度架构,用于基于点云的三维检测VoxelNet,直接在稀疏的三维点上操作,避免了人工特征工程引入的信息瓶颈。

我们提出了一种有效的方法来实现体素网,它既受益于稀疏点结构,又受益于体素网格上的高效并行处理。

我们在KITTI benchmark上进行实验,结果表明,在基于激光雷达的汽车、行人和自行车检测基准中,VoxelNet产生了SOTA结果

Methodology

分为三个功能模块:特征学习网络、卷积神经网络、区域提取网络

特征学习网络将原始点云作为输入, ...

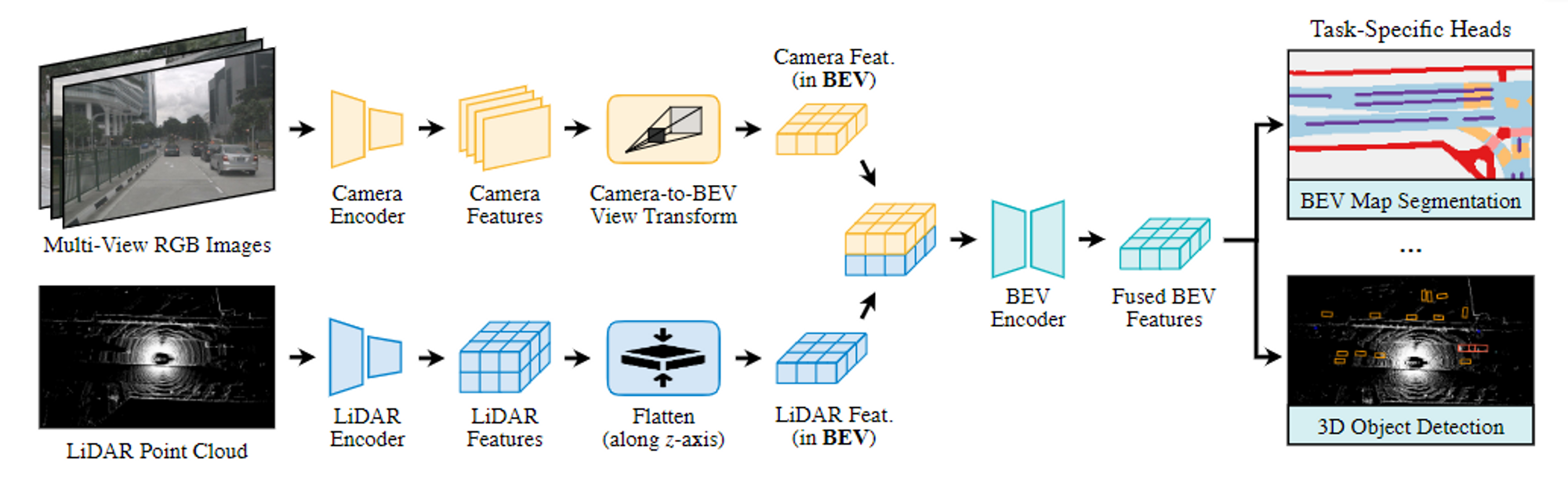

BEVFusion

BEVFusion: Multi-Task Multi-Sensor Fusion with Unified Bird’s-Eye View Representation

Author: MIT HanSong

Code: https://github.com/ADLab-AutoDrive/BEVFusion

Comment: BEV , attention

Completed: December 11, 2022

Key Words: Fusion, Object Detection

Score: ⭐️⭐️⭐️⭐️⭐️

Source: CVPR2022

Abstract

将多传感器融合对于准确可靠的自动驾驶系统至关重要。最近提出的方法基于点级(point-level)融合:使用摄像头特征增强激光雷达点云。然而,摄像头到激光雷达的投影丢弃了摄像头特征的语义密度(semantic density),阻碍了此类方法的有效性,尤其是对于面向语义的任务(如3D场景分割)。

本文提出的BEVFusion是一种多任务多传感器融合框架,其统一BEV表征空间中的多模态特征,很好地保留了几何和语义信息 ...

数字图像处理

边缘提取基本原理

图像边缘是图像最基本的特征,所谓边缘(Edge) 是指图像局部特性的不连续性。灰度或结构等信息的突变处称之为边缘。例如,灰度级的突变、颜色的突变,、纹理结构的突变等。边缘是一个区域的结束,也是另一个区域的开始,利用该特征可以分割图像。

图像的边缘有方向和幅度两种属性。边缘通常可以通过一阶导数或二阶导数检测得到。一阶导数是以最大值作为对应的边缘的位置,而二阶导数则以过零点作为对应边缘的位置。

要得到一幅图像的梯度,则要求在图像的每个像素点位置处计算偏导数。我们处理的是数字量,因此要求关于一点的邻域上的偏导数的数字近似,因此一幅图像在(x,y)位置和x,y方向上的梯度大小计算如下:

∂f(x,y)∂x=limx→0f(x+ϵ,y)−f(x,y)ϵ(1.1)\frac {\partial f(x,y) } {\partial x }=\lim_{x \to 0} \frac{f(x+\epsilon,y)-f(x,y)}{\epsilon} \tag{1.1}

∂x∂f(x,y)=x→0limϵf(x+ϵ,y)−f(x,y)(1.1)

∂f(x, ...

TransFusion

Author: Bai, Xuyang; Hu, Zeyu; Zhu, Xinge; Huang, Qingqiu; Chen, Yilun; Fu, Hongbo; Tai, Chiew-Lan;

Code: https://github.com/XuyangBai/TransFusion

Comment: soft calibration , attention

Completed: December 11, 2022

Key Words: Fusion, Object Detection

Link: arXiv:2203.11496

Score: ⭐️⭐️⭐️⭐️⭐️

Source: CVPR2022

Status: once

Abstract

针对:Lidar-camera fusion ,劣质图像鲁棒性差这个问题,认为是由当下的hard-association (calibration)导致的。

We propose TransFusion, a robust solution to LiDAR-camera fusion with a soft-association me ...

Data Fusion

基本概念

1.1 多传感器信息融合是用于包含处于不同位置的多个或多种传感器的信息处理技术

1.2 根据融合层次可以分为:数据级、特征级、决策级

特征级融合

先从各个传感器提供的原始数据中提取代表性特征,再把这些特征融合成单一特征向量;其中选择合适的特征进行融合是关键;特征信息包括边缘、方向、速度、形状

可以划分为目标状态融合和目标特性融合

目标状态融合:主要应用于多传感器的目标跟踪领域;融合系统首先对传感器数据进行预处理以完成数据配准,在数据配准之后,融合处理主要实现参数关联和状态估计。

目标特性融合:就是特征层联合识别,它的实质就是模式识别问题;在融合前必须先对特征进行关联处理,再对特征矢量分类成有意义的组合

📌 我感觉意思就是一个是先把数据配齐,然后一起放进去,一个是要把数据关联成一个大的特征向量

决策级融合

属于高层次级融合,是对数据高层次级的抽象,输出是一个联合决策结果,在理论上这个联合决策应比任何单传感器决策更精确或更明确;

决策层融合在信息处理方面具有很高的灵活性,系统对信息传输带宽要求很低,能有效地融合反映环境或目标各个侧面的不同类 ...

Image Gallery

壁紙

收藏的一些壁纸

漫威

关于漫威的图片

OH MY GIRL

关于OH MY GIRL的图片

Hello World

Welcome to Fanfer’s Blog(https://fanfer.top)! This is your very first post.

Quick Start

Create a new post

1$ hexo new "My New Post"

More info: Writing

Run server

1$ hexo server

More info: Server

Generate static files

1$ hexo generate

More info: Generating

Deploy to remote sites

1$ hexo deploy

More info: Deployment

basic usage

图床更新

12345$ # 将更改提交$ git add .$ git commit -m "更新图片"$ # 推送至github仓库$ git push

部署更新

1$ hexo clean; hexo generate; hexo deploy